Agroécologie Temps de lecture 6 min

Le suivi du bien-être des truies en groupe : arrêt sur image

Des chercheurs français testent un système d’analyse d’images permettant de reconnaître automatiquement la nature des interactions entre les animaux, qu’elles soient positives ou négatives. Ce système a été testé sur des groupes de truies, avec l’objectif de mieux assurer le bien-être de chaque individu au sein du groupe.

Publié le 03 décembre 2025

Depuis 2013, il est obligatoire d’élever les truies gestantes en groupe, et non plus isolées dans des cages. Cette mesure vise à améliorer leur confort et à favoriser l’expression de leur comportement naturel : elles peuvent bouger, explorer, interagir avec leurs congénères. Mais cette cohabitation n’est pas toujours paisible. Les truies établissent une hiérarchie sociale, parfois à coups de groin ou de morsures, qui peuvent nécessiter l’intervention de l’éleveur pour des mesures correctives.

Or, surveiller en permanence ces interactions pour détecter les problèmes demande du temps, du personnel et un œil expert. La solution testée par les chercheurs consiste à utiliser la vidéo et l’analyse d’image : un logiciel analyserait automatiquement les images filmées pour repérer les comportements sociaux de façon non intrusive et continue dans le temps.

Souriez, vous êtes filmées !

L’équipe du projet, regroupant INRAE, l’Ifip, l’Inria, et la société Dilepix, a filmé jour et nuit deux enclos de 19 et 20 truies gestantes dans des salles équipées de caméras.

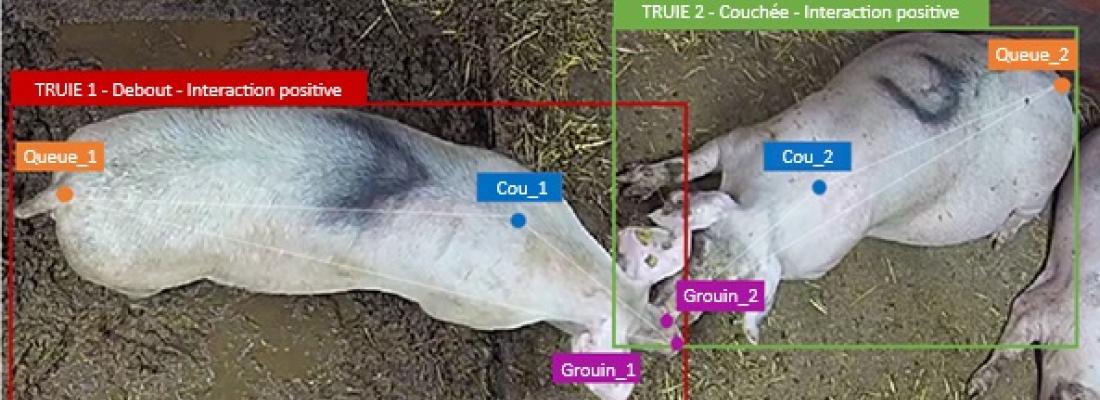

Le logiciel d’analyse des images permettait de caractériser la posture de chaque animal (couchée, assise, debout), ainsi que la position de trois points clés du corps : le groin, le cou et la queue.

Les analyses ont porté sur les stades 30 et 103 jours de deux gestations consécutives, au moment où l’activité était la plus grande, à savoir entre minuit et deux heures du matin (la ration quotidienne était mise à disposition à minuit). Les images ont été analysées manuellement à l'aide du système d’annotation du logiciel en cours de développement.

Au total, 360 situations ont été décrites à partir des images : i/ 120 correspondant à des moments d’interactions positives et 120 à des moments d’interactions négatives, incluant des images avant, pendant et après l’interaction entre deux individus ; ii/ 120 moments sans interaction (deux truies sans contact). La valence de l’interaction (positive ou négative), ainsi que la posture et les coordonnées des trois points clés de chaque truie ont été identifiées. En suivant la position et les mouvements de ces points clés sur les images, les chercheurs ont pu calculer les valeurs de 3 variables : les distances relatives entre les truies, les vitesses de déplacement et les distances individuelles parcourues.

Des arbres de décision ont été utilisés pour évaluer la pertinence de ces variables dans la détection d’une interaction.

Lorsque deux points d’intérêt de deux truies se rapprochent rapidement, une interaction commence ; lorsqu’ils s’éloignent, elle se termine. Si les deux truies sont debout, l’une avançant vite vers l’autre, cela peut signaler une interaction négative (agression). Si elles se reniflent tranquillement, il s’agit d’une interaction positive.

Sur la base de ces données, les chercheurs ont appris au logiciel (machine learning) non seulement à être capable de détecter automatiquement l’occurrence d’une interaction, mais aussi à en identifier :

• la nature positive (par exemple quand deux truies se touchent le groin) ou négative (comme les coups de tête ou morsures),

• l’orientation de l’interaction (contact groin-groin, groin-cou ou groin-queue)

Des résultats prometteurs

Les algorithmes ainsi « entrainés » ont permis de détecter le début et la fin d’une interaction avec 88 % de précision et de différencier dans 80 % des cas les interactions positives des interactions négatives.

Les interactions négatives se distinguent par des mouvements plus rapides, avec une truie qui semble fuir ou poursuivre l’autre.

Les interactions positives, au contraire, se font dans un contexte plus calme, souvent entre animaux familiers.

L’orientation du contact, utile pour identifier des comportements problématiques, a également été reconnue. L’orientation groin contre queue est typique d’interactions négatives, comme les morsures de la queue ou de la vulve, signe de stress ou de surpopulation. Cette détection groin-queue était particulièrement performante, avec 94 % de réussite.

Un pas de plus vers l’élevage de précision

Ce projet montre qu’il est possible de suivre automatiquement les relations sociales dans un groupe de truies grâce à l’analyse d’images. À terme, un tel outil pourrait alerter les éleveurs en cas de comportement anormal, par exemple une hausse d’agressions, avant que des blessures ou du stress n’apparaissent.

L’objectif n’est pas de remplacer l’œil de l’éleveur, mais de l’aider à mieux comprendre ce qu’« expriment » les animaux par leur comportement. En rendant visibles des détails imperceptibles à l’œil nu, la technologie offre un nouveau regard sur le bien-être animal : une étape vers des élevages caractérisés par davantage d’attention, de réactivité et de respect du bien-être animal.

Références : Blanc, A.; Poissonnet, A.; Thomas, J.; Courboulay, V.; Simon, M.; Gaillard, C., 2025. Toward the automatic detection of social interactions in gestating sows using image analysis data. Journal of Animal Science, 103: 14 - https://doi.org/10.1093/jas/skaf249